장단기 메모리(LSTM): RNN의 혁신적 발전

시계열 데이터 처리의 혁명을 이끈 LSTM 네트워크의 원리와 응용 분야

LSTM이란 무엇인가?

장단기 메모리(Long Short-Term Memory, LSTM)는 순환 신경망(RNN)의 한 종류로, 1997년 Sepp Hochreiter와 Jürgen Schmidhuber에 의해 제안된 인공 신경망 구조입니다. 기존 RNN의 장기 의존성 문제(Long-Term Dependency Problem)를 해결하기 위해 개발되었으며, 시계열 데이터 처리에 혁신적인 성능을 보여주고 있습니다.

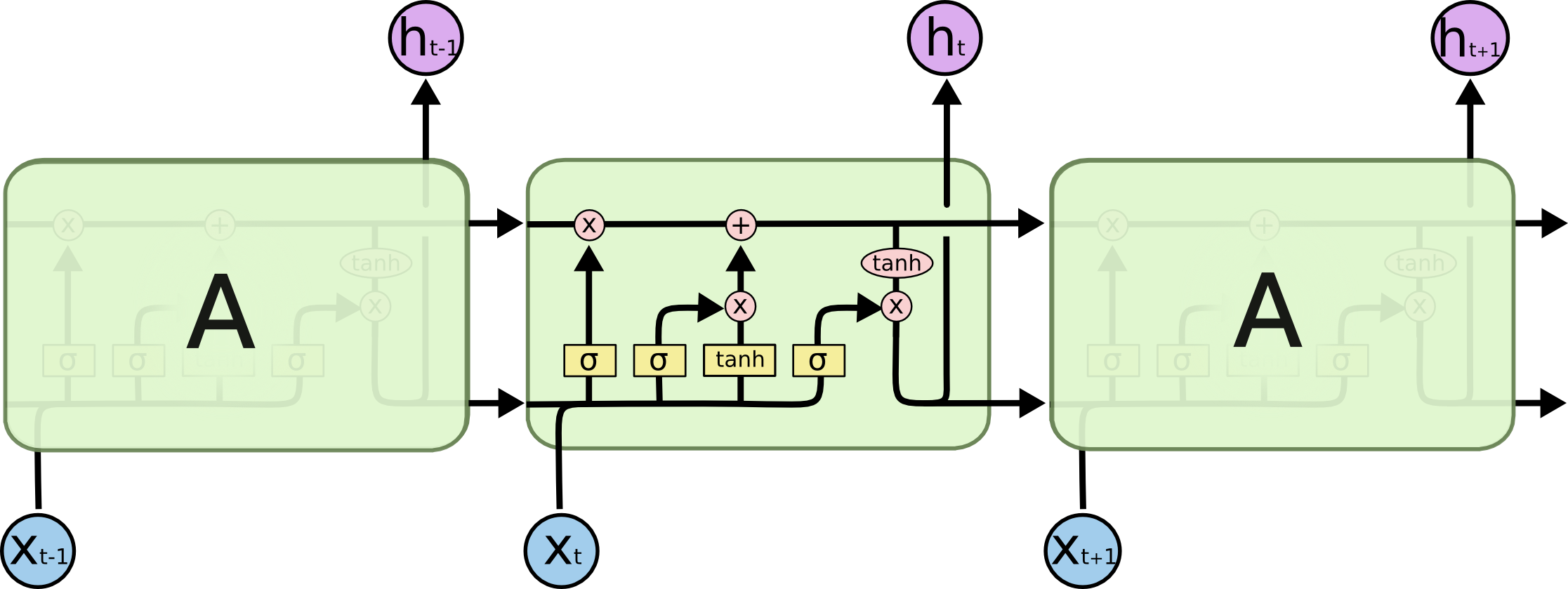

LSTM의 기본 구조 (출처: Medium)

핵심 개념

LSTM은 '기억 셀(memory cell)'이라는 특수한 구조를 도입하여 정보를 장기간 보존할 수 있는 능력을 갖추었습니다. 이는 인간의 뇌가 중요한 정보는 오래 기억하고, 중요하지 않은 정보는 잊어버리는 메커니즘과 유사합니다.

LSTM의 핵심 구조와 작동 원리

LSTM은 3개의 게이트(입력 게이트, 망각 게이트, 출력 게이트)와 하나의 셀 상태로 구성되어 있습니다. 이 구조들이 협력하여 정보의 흐름을 정교하게 제어합니다.

1. 입력 게이트(Input Gate)

새로운 정보 중 어떤 부분을 기억할지 결정합니다. 현재 입력과 이전 상태를 고려하여 셀 상태에 추가할 정보를 선택합니다.

2. 망각 게이트(Forget Gate)

이전 상태의 정보 중 어떤 부분을 버릴지 결정합니다. 이 게이트는 LSTM이 관련 없는 과거 정보를 잊을 수 있게 해줍니다.

3. 출력 게이트(Output Gate)

셀 상태의 어떤 부분을 다음 시간 단계로 출력할지 결정합니다. 이는 다음 셀의 입력으로 사용됩니다.

LSTM의 3가지 게이트 작동 원리 (출처: Colah's Blog)

LSTM의 이러한 게이트 메커니즘은 네트워크가 장기적인 의존성을 학습할 수 있게 해주며, 기존 RNN의 기울기 소실 문제를 효과적으로 해결합니다.

LSTM의 주요 장점

장기 의존성 학습

기존 RNN이 10단계 이상의 시퀀스에서 정보를 유지하기 어려웠던 반면, LSTM은 수백 단계의 시퀀스에서도 정보를 효과적으로 보존할 수 있습니다.

기울기 소실 문제 해결

게이트 메커니즘을 통해 역전파 시 기울기가 효과적으로 전파될 수 있는 경로를 유지하여 학습 안정성을 크게 향상시켰습니다.

다양한 시계열 데이터 처리

음성 인식, 자연어 처리, 주가 예측 등 다양한 시계열 데이터 처리에 탁월한 성능을 보입니다.

| 특징 | 기존 RNN | LSTM |

|---|---|---|

| 장기 의존성 처리 능력 | 제한적 (10단계 이내) | 뛰어남 (수백 단계 가능) |

| 기울기 소실 문제 | 심각함 | 효과적으로 해결 |

| 학습 안정성 | 낮음 | 높음 |

| 계산 복잡도 | 낮음 | 상대적으로 높음 |

LSTM의 주요 응용 분야

1. 자연어 처리(NLP)

- 기계 번역: Google 번역 등에서 문맥을 이해하는 데 사용

- 문장 생성: 뉴스 기사, 시 생성 등 창의적인 텍스트 생성

- 감정 분석: 리뷰나 SNS 데이터에서 감정을 판별

2. 음성 인식 및 생성

- 음성-텍스트 변환: Siri, Google 어시스턴트 등

- 음성 합성: 보다 자연스러운 음성 생성

3. 시계열 예측

- 주가 예측: 금융 시장 분석

- 기상 예보: 기상 데이터 패턴 분석

- 산업 장비 예지 보전: 고장 예측

LSTM의 다양한 응용 분야 (출처: ResearchGate)

LSTM의 한계와 발전 방향

LSTM의 주요 한계

- 계산 복잡도가 높아 학습에 많은 자원이 필요

- 매우 긴 시퀀스(1000단계 이상)에서는 여전히 한계 존재

- 게이트 구조로 인해 파라미터 수가 많아 과적합 가능성

LSTM의 발전 방향

- GRU(Gated Recurrent Unit): LSTM을 간소화한 모델로 계산 효율성 향상

- 양방향 LSTM(Bi-LSTM): 과거와 미래 정보를 모두 활용하는 구조

- Attention 메커니즘과의 결합: Transformer 아키텍처로의 발전

최근에는 Transformer 기반 모델들이 많은 NLP 작업에서 LSTM을 대체하고 있지만, LSTM은 여전히 계산 자원이 제한된 환경이나 특정 시계열 작업에서 유용하게 사용되고 있습니다.

'IT&과학 > 인공지능' 카테고리의 다른 글

| 자기부호화기(Autoencoder): 데이터 압축과 복원의 신경망 마법 (0) | 2025.04.20 |

|---|---|

| 게이트 순환 유닛(GRU): LSTM을 단순화한 신경망 구조 (0) | 2025.04.20 |

| 순환 신경망(RNN): 순차 데이터 처리의 핵심 기술 (0) | 2025.04.19 |

| 합성곱 신경망(CNN): 이미지 인식의 혁명을 이끄는 AI 기술 (0) | 2025.04.19 |

| 신경망의 심층화: 심층신경망(DNN)의 이해와 응용 (0) | 2025.04.19 |